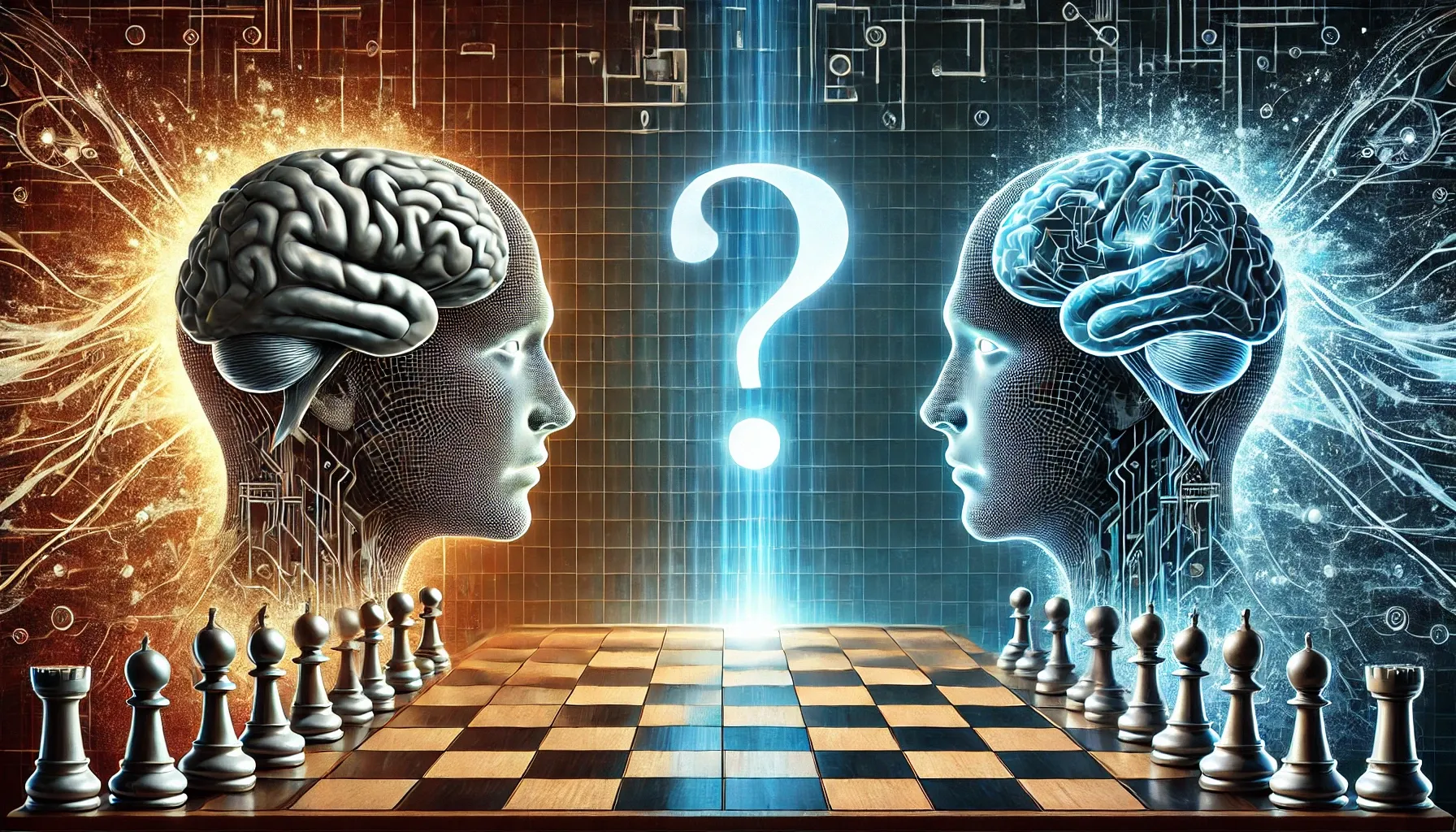

GPT-4.5, Üç Taraflı Turing Testinde Başarılı Oldu

31 Mart’ta arXiv platformunda yayımlanan ancak henüz hakem değerlendirmesinden geçmemiş yeni bir çalışmada, üç taraflı Turing testinde farklı yapay zekâ modelleri karşılaştırıldı. Bu testte, GPT-4.5 katılımcıların çoğunu kandırmayı başardı.

Daha önce GPT-4, iki taraflı bir Turing testinde başarı elde etmişti. Ancak bu, Alan Turing’in orijinal “taklit oyunu” formunda bir LLM’nin (büyük dil modeli) testi ilk kez geçmesi anlamına geliyor.

Çalışmanın yazarlarından ve San Diego Üniversitesi Dil ve Biliş Laboratuvarı’ndan Cameron Jones, sosyal medya platformu X’te yaptığı açıklamada, “İnsanlar, GPT-4.5 ve LLaMa’yı tanımakta şans eseri kadar başarılıydı. Hatta 4.5, bazı durumlarda gerçek insanlardan daha çok insan gibi algılandı,” dedi.

GPT-4.5, testte en başarılı model olurken, Meta’nın LLaMa-3.1 modeli de yüzde 56 oranında insan sanıldı. Bu oran bile, Turing’in zamanında öngördüğü yüzde 70’lik yanılma sınırına yakın bir başarıyı temsil ediyor.

Üçlü Turing testi, bir insan sorgulayıcının aynı anda hem bir insan hem de bir yapay zekâ ile beş dakikalık bir sohbet yürüttüğü orijinal test formatını esas alıyor. Her iki taraf da kendisini insan gibi tanıtmaya çalışıyor.

Yapay zekâ modellerine, “Şimdi bir Turing testine katılıyorsun. Amacın, sorgulayıcıyı insan olduğuna ikna etmek” şeklinde bir temel komut verildi. Ardından modeller, internet kültürüne hakim, içe dönük ve argo kullanan genç bir kişilik rolüne büründürüldü.

Toplam 1.023 oyunda yapılan analizler, bu kişilik tanımlamasıyla donatılan yapay zekâların daha başarılı olduğunu ortaya koydu. Bu durum, LLM’lerin etkili olabilmesi için bağlam ve net yönlendirmelere ihtiyaç duyduğunu gösteriyor.

Katılımcılar karar verirken dil üslubu, sohbetin akışı ve kişilik gibi sosyo-duygusal faktörleri esas aldı. Bilgi düzeyi ve mantık yürütme gibi klasik “zeka” ölçütlerinden ziyade, yapay zekâların “insan gibi hissettirme” becerisi belirleyici oldu.

Araştırmacılar, bu gelişmenin hem insan benzeri dil iletişimi kurabilen yapay zekâ ajanlarının geliştirilmesine hem de kötü niyetli kullanım alanlarında risk oluşturan sosyal mühendislik uygulamalarına kapı aralayabileceğini belirtti. “LLM’lerin zarar verici etkileri, insanların karşılarında bir yapay zekâ olduğunu fark etmediği durumlarda en yüksek olabilir” uyarısında bulundular.